Beim Durchforsten der Search-Console-Berichte stößt man immer wieder auf nicht indexierte Seiten. Im Abdeckungsbericht liest man oft diese zwei Meldungen:

- Gefunden – Zurzeit nicht indexiert

- Gecrawlt – Zurzeit nicht indexiert

Doch woran mag es liegen, dass Google sich manchmal vehement weigert, URLs in den Index aufzunehmen. Wir gehen der Problematik auf den Grund & zeigen dir, wie du Google für die Indexierung motivierst.

Gecrawlt vs. gefunden – Was heißt das eigentlich?

Was ist überhaupt der Unterschied zwischen gefunden und gecrawlt? Und wie verschieden sind die Ursachen laut Google?

Gefunden – zurzeit nicht indexiert: Google hat gesehen, dass die Seite existiert – Meist über eine interne Verlinkung oder die Sitemap.

Laut Google sei die Website beim Crawlingversuch überlastet gewesen, sodass das Crawling neu geplant wurde. (Quelle: Google)

Man kann hier unter anderem davon ausgehen, dass das Crawling Budget (Crawling Kapazität) überschritten wurde, welches vom PageRank (Linkpopularität) abhängt. So werden die Crawling Kapazitäten für Websites mit mehr Autorität deutlich höher dosiert.

Gecrawlt – zurzeit nicht indexiert: Google hat die Inhalte der Seite heruntergeladen und erkannt. Die URL könnte in Zukunft indexiert werden. (Quelle: Google)

Ursachen

Die Aussagen von Google sind in diesem Fall wenig hilfreich. Hier lohnt es sich, einen Blick hinter die Kulissen und somit auf die tatsächlichen Gründe zu werfen.

Im Großen und Ganzen ist Google der Auffassung, dass die Inhalte nicht relevant genug seien. Das kann an folgenden Faktoren liegen:

- Inhalt zu kurz

- Nirgendwo verlinkt

- Schlechte Performance

- Automatisch erzeugte Inhalte und URLs / Leere Übersichtsseiten

- Duplicate Content

Bei „Gefunden – zurzeit nicht indexiert“ fehlen in der Regel die Verlinkungen, denn Google kennt den Inhalt ja noch nicht. Daher sind andere Ursachen ausgeschlossen.

Wenn Google den Inhalt bereits gecrawlt hat, können Verlinkungen dennoch eine Ursache sein. Sie sind schließlich maßgeblich für die Beurteilung der Wichtigkeit des Inhalts.

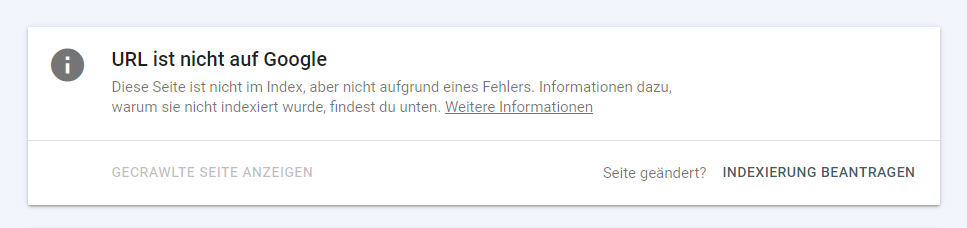

Quickfix: Indexierung beantragen

Wenn es dir lediglich um eine oder ein paar wenige Seiten geht, kannst du in der Search Console die Indexierung der Seite beantragen. Das ist jedoch keine Garantie dafür, dass Google sie dann auch wirklich indexiert.

Gehe dazu wie folgt vor:

- Klicke im Abdeckungsbericht auf „URL prüfen“ (Lupensymbol).

- Klicke dann auf „Indexierung beantragen“.

1. Bericht aufräumen: Alle bekannten Seiten vs. alle eingereichten Seiten

Wenn du dich dem Fehler ganzheitlich annehmen willst, solltest du zunächst einmal deinen Abdeckungsbericht aufräumen. Standardmäßig ist er auf „Alle bekannten Seiten“ eingestellt.

Der Nachteil hierbei: Du siehst unter anderem viele unnötige URLs wie leere Verzeichnisse, Kategoriefeeds und Parameter-URLs. Was dich aber eigentlich interessieren sollte, sind Seiten mit realem Content.

Stelle ihn erst einmal lieber auf „Alle eingereichten Seiten“ ein – So siehst du nur URLs aus der Sitemap, also den wirklich wichtigen Inhalt.

2. Aktualität kontrollieren: URLs prüfen

Der Abdeckungsbericht ist leider nicht immer topaktuell. Manche URLs (vorwiegend neue) werden dort vielleicht noch angezeigt, obwohl sie in Wirklichkeit schon indexiert wurden.

Das manuelle Überprüfen (über das Lupen-Symbol) wäre für ein paar mehr URLs ohne Frage ein viel zu hoher Aufwand. Mit dem Google Bulk Inspection Tool kannst du den gleichen Vorgang per Massenbearbeitung durchführen.

Befolge dazu folgende Schritte:

- Exportiere dir eine Liste aller URLs mit dem Fehler aus dem Abdeckungsbericht

- Öffne https://valentin.app/inspect.html

- Klicke auf „Authorize“, um deinen Search-Console Account zu verbinden

- Wähle deine Property aus (2. select property)

- Kopiere dir nun alle URLs aus der Liste und füge sie im dafür vorgesehenen Feld ein

- Klicke nun auf „4. inspect URLs“, um eine Auswertung zu erhalten

In der Ergebnistabelle siehst du nun den Punkt „coverageState“. Dort wird angezeigt, ob die Seite indexiert wurde oder nicht.

Exportiere dir die Tabelle und filtere die Spalte nach „Discovered – currently not indexed“ und „Crawled – currently not indexed“. Dann hast du alle URLs, die nach aktueller Prüfung noch nicht indexiert wurden.

Hier findest du weitere Informationen zur Aufschlüsselung der Statuscodes.

3. Lösungswege

Welche Maßnahmen kannst du nun ergreifen, um den Fehler zu beseitigen und zukünftig zu vermeiden. Du solltest dir keine falschen Erwartungen stellen, denn nur sehr wenige Websites schaffen es, eine Indexierungsrate von 100% aufrechtzuerhalten.

1. Quickfix: Indexierung beantragen

Wie bereits oben erläutert, kannst du für einzelne URLs die Indexierung beantragen. Wenn du versiert in JavaScript bist, kannst du diesen Vorgang per Script auch mit einer Massenbearbeitung durchführen.

2. Interne Verlinkung verbessern

Wenn du Google zeigen möchtest, dass deine Seite wichtig ist, verlinke sie an prominenter Stelle. Das heißt zum Beispiel in der Navigation, auf der Startseite im Content oder im Footer.

Die aktuellen internen Verlinkungen werden auch im Bulk Inspection Bericht angezeigt.

3. Externe Verlinkung verbessern

Hochwertige Backlinks implizieren Relevanz – Also solltest du dafür sorgen, dass mehr andere Seiten auf deine verweisen. Mehr dazu findest du in unserem Beitrag über Backlinks / Offpage Optimierung.

4. Content verbessern

Ein Faktor für die Relevanzevaluierung deiner Webseite ist natürlich der Content selbst. Achte daher auf folgende Parameter:

- Performance: Ladezeit schnell genug?

- Übersichtlichkeit: Findet sich der User gut zurecht?

- Lesbarkeit: Sind die Sätze klar genug formuliert oder besteht dein Inhalt aus tausenden Schachtelsätzen?

- Umfang: Ist dein Inhalt lang genug? Vergleiche ihn mit den Top 10 der SERPs zu deinem Hauptkeyword.